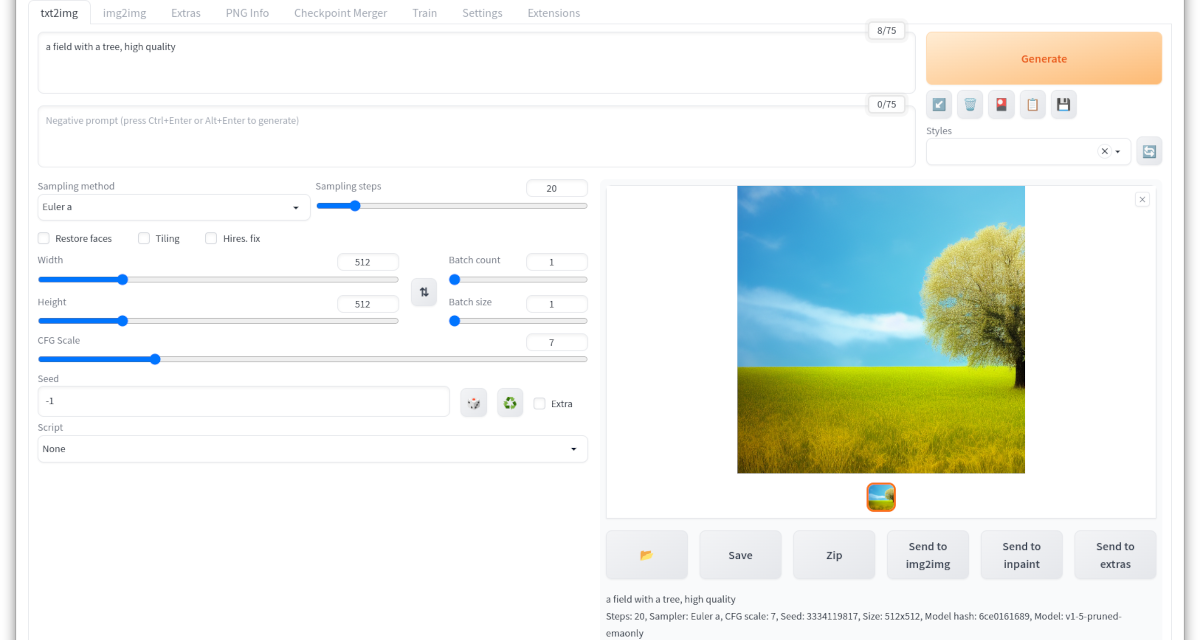

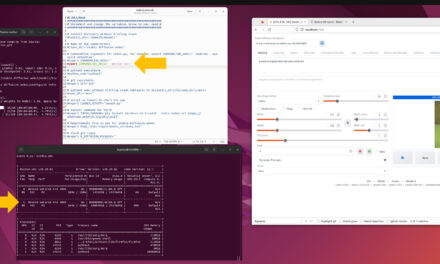

Nach dem im ersten Teil der Installationsanleitung alle Vorraussetzungen geschaffen wurden folgt jetzt im zweiten Teil der Anleitung die Installation von Automatic1111. Das klappt so gut das ich selber sehr erstaunt war wie einfach es war. Wichtig ist, dass ihr die Installation jetzt wenn von euch eingerichtet in der aktiven Anaconda Umgebung „stable-diffusion“ vornehmt. Wenn ihr auf Anaconda verzichtet habt dann installiert ihr Automatic1111 direkt in eurem System. Wie die Web-Overfläche dann aussieht seht ihr schon einmal im folgenden Bild das ich hier vorab eingefügt habe.

Jetzt geht es aber los mit der Installation.

AUTOMATIC1111 installieren

Die original Installationsanleitung für AUTOMATIC1111 der ich gefolgt bin findet sich unter der nachfolgenden URL auf English. Ich habe für die Anleitung hier die Befehle nach einander aufgereiht so das ihr diese nur einen nach dem anderen in eur Terminal Fenster kopieren müsst.

URL: https://github.com/AUTOMATIC1111/stable-diffusion-webui#automatic-installation-on-linux

Da mein Vorgehen ist alles in der Conda Umgebung zu installieren muss diese wenn noch nicht geschehen aktiviert werden.

Befehl: conda activate stable-diffusion

Jetzt geht es mit der Installation los. Dazu bitte die beiden nachfolgenden Befehle im Terminal Fenster unter Ubuntu 22.04 ausführen um auch die aktuellen und benötigten Python3 Bibliotheken zu installieren..

Befehl: sudo apt install wget git python3 python3-venv

Befehl: sudo apt install python3-pip

Befehl: pip install xformers

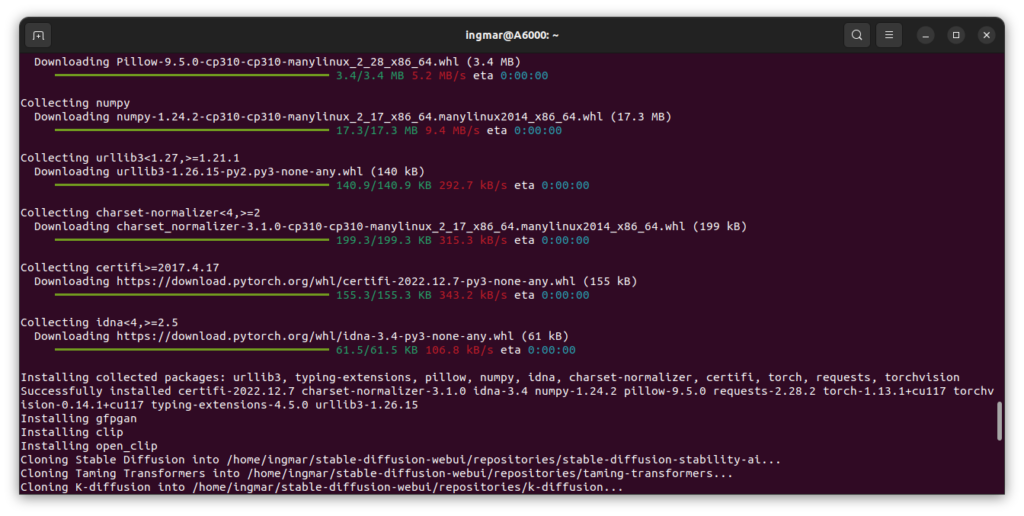

Jetzt sind die Vorraussetzunge geschaffen und ihr führt jetzt den folgenden Befehl aus. Dieser installiert jetzt Automatic1111 und installiert dafür einiges an Software auf eurem System. Das dauert jetzt ein paar Minuten je nach Internetanbindung und Geschwindigkeit von eurem Rechner.

Befehl: bash <(wget -qO- https://raw.githubusercontent.com/AUTOMATIC1111/stable-diffusion-webui/master/webui.sh)

Das folgende Bild zeigt einmal die Ausgabe im Terminal Fenster wie diese bei mir aussah.

Nach dem alles Installiert wurde startet die Stable Diffusion web UI Umgebung automatisch. Möchtet ihr nach einem Neustart des PC die Umgebung manuell wieder selber starten dann geht das mit dem folgenden Befehl ausgeführt über das Terminal im Installationsordner „stable-diffusion-webui„.

Befehl: bash webui.sh

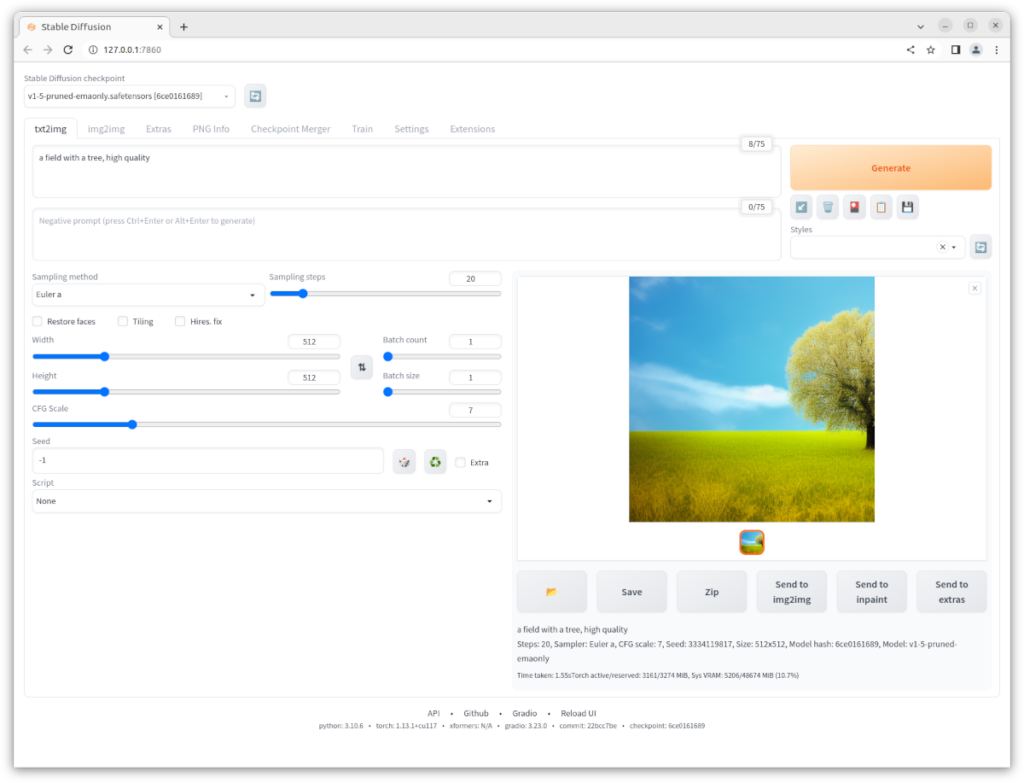

Im Browser könnt ihr jetzt die Web-Oberfläche der Stable Dissufion Umgebung über die folgende URL aufrufen. Das Netz v1-5-pruned-emaonly.safetensors wurde direkt während der Installation bereits herunter geladen und mit diesem könnt ihr die ersten Bilder genieren lassen.

URL: http://127.0.0.1:7860/

Trainierte Modelle inzufügen

Damit auch die Umgebung genutzt werden kann und Bilder generiert werden können müssen zusätzlich die verschiedenen im Internet angebotenen CheckPoint Dateien der bereits trainierten Modelle herunter geladen werden. Dazu jetzt einmal zum Start das Stable Diffusion 2.0 Modell als Checkpoint Datei herunter laden.

Download checkpoint Model: 768-v-ema.ckpt

Weiter wird noch das config File benötigt welches ihr auch noch herunter laden müsst.

Download Config: config file,

Diese Konfigurationsdatei muss umbenannt werden so dass dieses wie das Modell heißt also wie folgt

neuer Dateiname: 768-v-ema.yaml

Jetzt muss die Checkpoint Datei und die umbenannte Konfigurationsdatei in den Installationsordner der Stable Diffusion web UI verschoben werden.

Pfad: /home/<Benutzername>/stable-diffusion-webui/models/Stable-diffusion

<Bild vom Ordner>

Anschließend die Umgebung beenden falls diese noch gestartet war und neu laden.

Befehl: bash webui.sh

Wenn im Terminal Fenster die Umgebung gestartet ist dann über den Browser diese wieder öffnen. Das hinzugefügte Modell könnt ihr links oben in der Drop Down Box auswählen. Diese Drop Down Box wird dann relevant wenn ihr verschiedene Modelle hinzugefügt habt.

URL: http://127.0.0.1:7860/

Sollen im eigenen Netzwerk auf andere Computer auf das Web-Interface zugreifen können, dann muss der folgende Befehl ausgeführt werden mit --listen angehängt.

Befehl: bash webui.sh --listen

Sollen parallel mehrere Instanzen genutzt werden mit unterschiedlichen neuronalen Netzen die in die Grafikkarte geladen werden dann sollten diese Instanzen auf je einem eigenen Port gestartet werden. Der Befehl dafür sieht dann wie folgt aus.

Befehl: bash webui.sh --listen --port XXXX

Port Beispiel:

Befehl: bash webui.sh --listen --port 7861

Bei weiteren Fragen zur Konfiguration von AUTOMATIC1111 findet ihr die Parameter bzw. Möglichkeiten der Konfiguration unter der folgenden Seite:

URL: https://github.com/AUTOMATIC1111/stable-diffusion-webui/wiki/Command-Line-Arguments-and-Settings

Ab jetzt könnt ihr eure eigenen Prompts bauen und ausprobieren was wie passiert.

Angebot von vortrainierten Netzen

Eine Auswahl von bereits trainierten Netzen möchte ich hier nicht selber erstellen. Auf der Seite von Stable-Diffusion-Art.com gibt es eine sehr gute Sammlung solcher Modelle mit kurzer Erklärung und jeweils mindestens einem Beispielbild. Daher verweise ich an dieser Stelle auf die toller Arbeit von Stable-Diffusion-Art.

URL: https://stable-diffusion-art.com/models/

Auch interessante Modell rund um das Thema Architektur oder auch Essen / Lebensmittel können wir angeschaut sowie auch herunter geladen werden. An einer Integration bzw. Version die auf AUTOMATIC1111 aufsetzt wird ebenfalls gearbeitet wenn ich das hier richtig verstanden habe. Das würde den Zugriff auf diese Modelle natürlich deutlich vereinfachen.

Aber hier einmal die Seite.

URL: https://civitai.com/

Ich selber habe die folgenden Netze bis jetzt einmal herunter geladen und verwende diese aktuell zum ausprobieren.

- 768-v-ema.ckpt

- 768-v-ema.yaml

- anything-v3-fp16-pruned.safetensors

- chilloutmix_NiPrunedFp32Fix.safetensors

- f222.ckpt

- mdjrny-v4.ckpt

- robo-diffusion-v2-base.ckpt

- sd-v1-4.EVyFFLZs.ckpt.part

- train.ckpt

- v1-5-pruned-emaonly.ckpt

Zusammenfassung

Ich war sehr erstaunt wie einfach die Installation klappte und wie leicht es war das ich auf die Web-Oberfläche zugreifen konnte. So ist es jetzt jedem an dieser Technik interessierten möglich sich in das Thema Stable-Diffusion einzuarbeiten und sich damit vertraut zu machen. Da wird einem dann auch richtig bewusst was alles möglich ist und wie schwierig es in der Zukunft sein wird seinen Augen noch trauen zu können. Wir sind jetzt einfach mit Chat-GPT oder auch ganz frisch von META Segment Anything in einer ganz spannenden AI Zeit angekommen. Wichtig ist hier meiner Meinung nach keine Angst vor der Technologie als solches zu haben aber man muss diese verstehen und wissen was alles möglich ist. Nur so kann man die Welt in der man sich jetzt befindet ob gewollt oder nicht noch begreifen und vorallem verstehen.

Artikelübersicht - Stable Diffusion:

Stable Diffusion - AUTOMATIC1111 Ubuntu Installation Teil 1/2Stable Diffusion - AUTOMATIC1111 Ubuntu Installation Teil 2/2

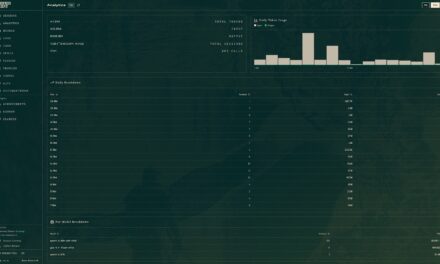

Stable Diffusion - Bilder lokal generieren mit Prompt Beispielen

Stable Diffusion - AUTOMATIC1111 Experten Konfiguration

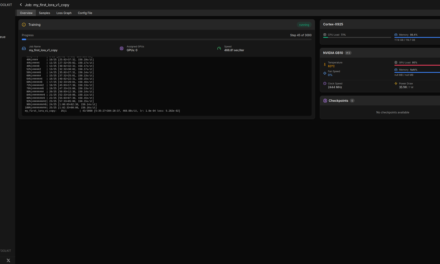

Stable Diffusion - Dreambooth Training Finetuning einrichten Teil 1/2

Stable Diffusion - Dreambooth Training Finetuning ausführen Teil 2/2

Hallo,

ich habe ihre Anleitung befolgt und bekomme im letzten Schritt leider immer folgende Meldung im Terminal:

bash <(wget -qO- https://raw.githubusercontent.com/AUTOMATIC1111/stable-diffusion-webui/master/webui.sh)

################################################################

Install script for stable-diffusion + Web UI

Tested on Debian 11 (Bullseye)

################################################################

################################################################

Running on benedikt user

################################################################

################################################################

Clone stable-diffusion-webui

################################################################

fatal: Konnte Arbeitsverzeichnis 'stable-diffusion-webui' nicht erstellen: Datei oder Verzeichnis nicht gefunden

/dev/fd/63: Zeile 192: cd: stable-diffusion-webui/: Datei oder Verzeichnis nicht gefunden

ERROR: Can't cd to /dev/fd/stable-diffusion-webui/, aborting…(stable-diffusion

Können sie mir vielleicht sagen, wie ich das beheben kann ? Vllt. das Verzeichnis selbst erstellen. Ich bin leider im Terminal nicht sonderlich fit. Ich bin ein Blender Nutzer und möchte über Render AI Stable Diffusion in Blender zum rendern verwenden.

Dankeschön im Vorraus.

Mit freundlichen Grüßen

Benedikt Durnberger