LLM Agenten arbeiten eigenständig – mit CrewAI automatisieren

In diesem Beitrag möchte ich euch meine Anwendung vorstellen die in der Lage ist im Internet...

von Maker | März 31, 2024 | Large Language Models, Top story | 2 |

In diesem Beitrag möchte ich euch meine Anwendung vorstellen die in der Lage ist im Internet...

von Maker | Mai 26, 2022 | AI Pipeline | 2 |

von Maker | Mai 26, 2022 | AI Pipeline | 0 |

von Maker | Okt. 4, 2025 | Large Language Models, Top story | 0 |

Du hast den ersten großen Schritt getan: Dein eigner, unabhängiger Ollama-Server läuft, die Tokens...

von Maker | Mai 26, 2022 | AI Pipeline | 0 |

von Maker | Mai 26, 2022 | AI Pipeline | 0 |

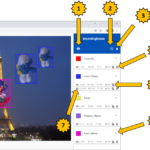

von Maker | Juni 17, 2023 | Stable Diffusion, Top story | 0 |

von Maker | Juni 9, 2026 | AI Pipeline, Large Language Models, Top story | 0 |

Nous Research hat seinem quelloffenen Hermes Agent mit dem „Surface Release“ (Version 0.16.0, Juni...

von Maker | Juni 8, 2026 | Large Language Models, News, Top story | 0 |

von Maker | Mai 30, 2026 | AI Pipeline, Large Language Models, Top story | 0 |

von Maker | Juni 9, 2026 | AI Pipeline, Large Language Models, Top story | 0 |

Nous Research hat seinem quelloffenen Hermes Agent mit dem „Surface Release“ (Version 0.16.0, Juni...

Weiterlesenvon Maker | Juni 8, 2026 | Large Language Models, News, Top story | 0 |

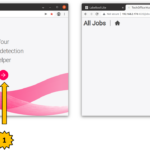

Wer wie ich seine Modelle lokal und souverän betreibt, kennt das Problem: Ich will wissen, wie...

Weiterlesenvon Maker | Mai 30, 2026 | AI Pipeline, Large Language Models, Top story | 0 |

Mein Hermes Agent kann seit einer Weile im Web suchen und Seiteninhalte extrahieren. Das habe ich...

Weiterlesenvon Maker | Mai 29, 2026 | AI Pipeline, Software, Top story | 0 |

Wer komplexe Infrastrukturen dokumentiert, stößt mit statischen Diagrammen und MS PowerPoint als...

Weiterlesenvon Maker | Mai 26, 2026 | Large Language Models, News, Top story | 0 |

Schon länger juckt es mich in den Fingern: Firecrawl selbst gehostet, im eigenen LAN, ohne...

Weiterlesenvon Maker | Mai 26, 2026 | AI Pipeline, Large Language Models, Top story | 0 |

In den letzten zwei Beiträgen habe ich Euch gezeigt, wie ich NemoClaw auf einem Dell OptiPlex 5040...

Weiterlesen

Ein toller Guide der leicht zugänglich und verständlich ist. Perfekt für ein kleines Side-Project geeignet. Aktuell half mir noch mein…

Thank you for this great tutorial, could you share n8n workflow and comfyui workflow please?

Hallo Anton, die Meldung besagt das in meinem Beisiel Methoden verwendet werden die veraltet (deprecated) sind. Also müsstest Du die…

Danke für das Tool! Ich habe erst kürzlich angefangen mich mit der Thematik zu beschäftigen und bin für meine Erwartungen…

Hallo, ich habe ihre Anleitung befolgt und bekomme im letzten Schritt leider immer folgende Meldung im Terminal: bash <(wget -qO-…