Nachdem ich euch in meinen Beitrag zum Thema „Souveräne KI“ gezeigt habe, wie ich mit Ollama und Docker meinen eigenen, unabhängigen LLM-Server auf NVIDIA-GPUs aufgebaut habe, möchte ich jetzt einen Schritt weiter gehen. Die Frage, die mich seit Wochen beschäftigt: Wie weit lässt sich generative KI vom Inferenz GPU-Server bis hinunter auf einen kleinen Mikrocontroller bringen und was kann ich damit anstellen?

Die Antwort darauf ist eine ganze neue Beitragsserie, die ich heute hier auf meinem Blog starte. Im Zentrum steht ein wie ich finde neues und sehr interessantes Framework von Espressif namens ESP-Claw, ein HMI-Board mit ESP32-P4 und mein Wunsch, meine bestehenden Roboter-Autos über einen lokalen KI-Agenten zu steuern. Das ESP32-Claw Framwork findet ihr hier: https://github.com/espressif/esp-claw

Worum geht es in dieser neuen Serie?

In dieser Serie geht es nicht um den physischen Bau eines Roboters. Wer die mechanische und elektronische Seite meiner Roboter-Autos kennenlernen möchte, findet alle Bauanleitungen, Schaltpläne und Mechanik-Themen wie gewohnt auf meinem zweiten Blog custom-build-robots.com. Hier auf meinem Blog ai-box.eu hier liegt der Fokus ausschließlich auf der KI-Schicht.

Wie kam es zu der Idee?

Ich habe für zwei Schulprojekte bei meiner Tochter eine Vielzahl an Roboter-Autos gebaut. Dann habe ich immer wieder Gespräche mit Kolleginnen und Kollegen die z. B. erzählen das die eigene Mutter die Waschmaschine die Sie seit 55 Jahren ohne Probleme bedienen konnte nicht mehr bedienen kann. Die Eltern stehen vor dem Gerät und wissen nicht mehr wie es geht. Sie merken es stimmt etwas nicht trauen sich aber nicht die Kinder anzurufen. Können wir da nicht einen Comaninen entwerfen der lokal unaufdringlich helfen kann?

Kurz gesagt an Hardware wie Roboter-Autos, Elektronik und Ideen mangelt es mir nicht.

Los geht es mit einer kleinen Übersicht der Themen die es gilt zu lösen:

- Wie läuft überhaupt ein LLM-Agent auf einem ESP32-P4?

- Wie spricht ein Mikrocontroller mit meinem lokalen Ollama-Server?

- Was sind „Skills“ und „Capabilities“ in einem Edge-Agent auf einem Mikrocontroller?

- Wie verwandle ich gesprochene Befehle in Aktionen am Roboter?

- Welche Sensoren und Aktoren kann ich steuern und wie?

- Wie integriere ich Tool-Calling, Speicher und MCP-Server auf einer Hardware mit 32 MB RAM?

Das Ziel am Ende der Serie bzw. meines Weges:

Ein Roboter-Auto bzw. Endgerät, das ich mit natürlicher Sprache steuern kann. Dieses soll vollständig lokal, ohne Cloud, ohne API-Keys an externe Anbieter arbeiten können. Genau das, was ich unter „Souveräne KI“ verstehe.

Was ist ESP-Claw eigentlich?

ESP-Claw ist ein neues Open-Source-Framework von Espressif, das auf ihren leistungsstarken ESP32-P4-Chips läuft. Vereinfacht gesagt: ESP-Claw macht aus einem Mikrocontroller einen vollwertigen, eigenständigen KI-Agenten mit allem, was dazugehört:

| Komponente | Was sie macht | Warum das wichtig ist |

| LLM-Anbindung | Spricht mit OpenAI, Anthropic, Aliyun Bailian, oder einem lokalen Ollama Inferenz-Server | Ich bleibe Herr meiner Daten – das LLM läuft auf meinem A6000-Server |

| Capabilities | Vordefinierte Fähigkeiten (Messenger, Dateien, Web-Suche, Scheduler) | Modulares Erweitern wie bei einem App-Store |

| Skills | Eigene Funktionen, die das LLM aufrufen kann (Tool-Calling) | Hier verbinde ich Sprache mit Roboter-Hardware |

| Lua-Runtime | Skripte zur Laufzeit ausführen | Logik anpassen ohne die Firmware neu zu flashen |

| MCP-Server | Model Context Protocol – Standard für KI-Integrationen | Mein ESP32 wird zum Server für andere KI-Tools |

Das alles läuft auf einem einzigen Chip, mit Display, Touch, Audio, WiFi und Bluetooth. Genau das, was man eine All-in-One-Edge-AI-Plattform nennt.

Warum ein HMI-Board? Warum nicht direkt ein Raspberry Pi?

Eine berechtigte Frage. Mein Standpunkt dazu ist klar: Ein Human-Machine-Interface-Board – also ein Mikrocontroller mit eingebautem Touchscreen – ist die ideale Plattform für einen Edge-Agenten:

- Boot-Zeit: 1–2 Sekunden statt 30–60 Sekunden wie bei einem Pi

- Stromverbrauch: Wenige Hundert Milliwatt statt 5–10 Watt

- Robustheit: Kein Linux-Dateisystem, das sich beim plötzlichen Stromausfall korrumpiert

- Echtzeit: Direkter Zugriff auf GPIO, I²C, UART, PWM – ideal für Robotik

- Preis: Boards wie das Guition JC1060P470 gibt es für unter 25 Euro und der Raspberry Pi kostet hier deutlich mehr.

Das ist kein theoretischer Vorteil. Wenn ich vor meinem Roboter-Auto stehe und es per Sprachbefehl steuern möchte, will ich nicht auf einen Linux-Boot warten. Ich will so schnell wie möglich loslegen.

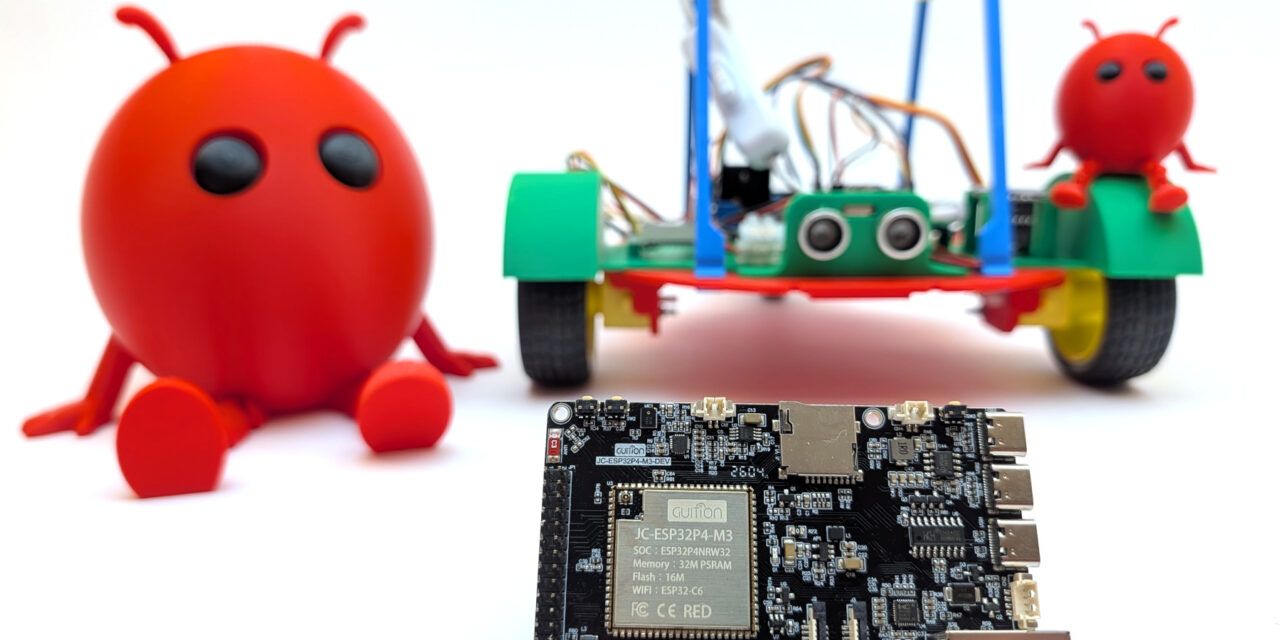

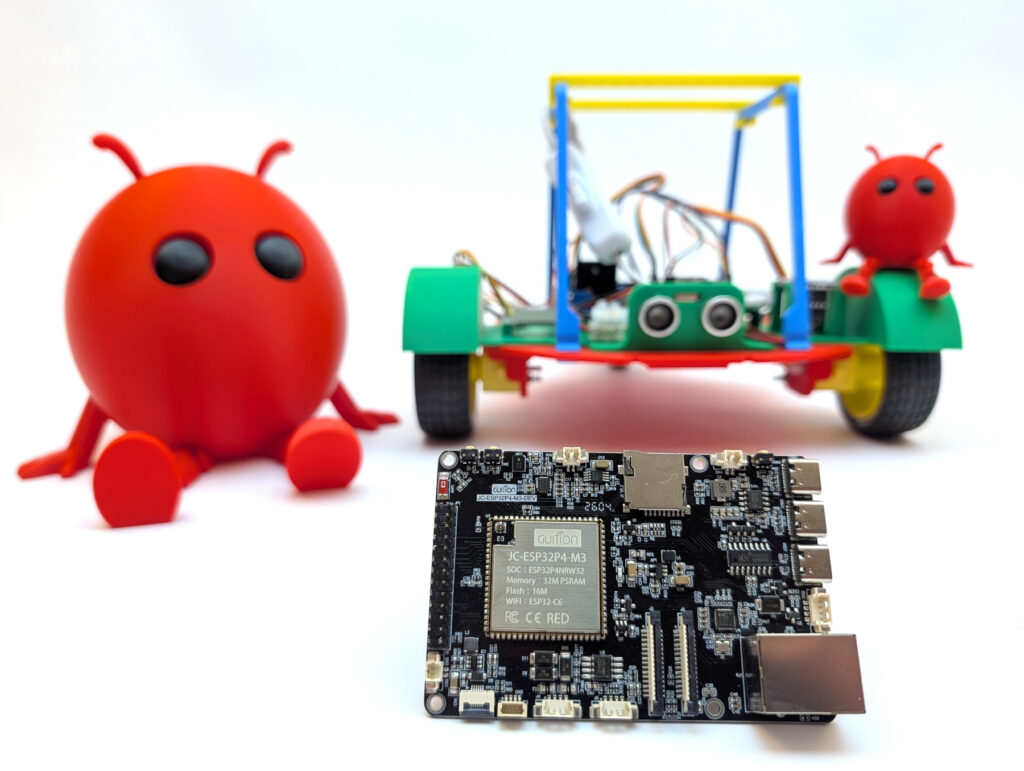

Meine Ausgangsbasis: Das Guition JC1060P470

Ich will hier ehrlich sein. Ich hatte einfach auf Ali Express nach einem ESP32-P4 Board geschaut das viele Anschlüsse bietet und unter 30,-€ kostet. So ist es dann ein Guition JC1060P470 geworden. Ein HMI-Board mit folgender Ausstattung:

- ESP32-P4 als Haupt-SoC (RISC-V Dual-Core, 360 MHz)

- ESP32-C6 als Co-Prozessor für WiFi 6 und Bluetooth 5 (per ESP-Hosted SDIO angebunden)

- 7-Zoll IPS-Display mit 1024×600 Pixeln und MIPI-DSI-Anbindung (bei mir nicht mit dabei)

- Kapazitiver Touch (GT911)

- Audio-Codec ES8311 mit Mikrofon und Lautsprecher-Anschluss

- microSD-Slot, RJ45-Ethernet

- 16 MB Flash, 32 MB Octal-PSRAM

Alles für rund 25 Euro und ich konnte einfach nicht wiederstehen es zu kaufen um endlich einen ESP32-P4 mein eigenen nennen zu können.

Mein Ziel: Souveränität auch bei der Hardware

Der Plan ist simpel, aber technisch herausfordernd:

- ESP-Claw kompilieren und auf das Board flashen – inklusive eigener Board-Adaption wie ich lernen musste

- Anbindung an meinen Ollama-Server auf dem ich verschiedenen Modelle betreibe

- Eigene Skills entwickeln, die mein ESP32-basiertes Roboter-Auto über WiFi steuern

- Sprach-Interaktion über Mikrofon und Lautsprecher direkt am HMI-Board

- Lua-Skripte schreiben, die Verhaltensmuster definieren („Suche das rote Objekt“, „Fahre in die Küche“)

Die LLM-Inferenz bleibt dabei immer in meinen vier Wänden. Mein Roboter spricht mit Qwen 3.6 35B auf meinem eigenen Server. Es besteht keine Verbindung zu OpenAI & Co außerhalb Europas. Das ist der rote Faden, der sich durch alle meine Beiträge zieht: Volle Kontrolle, kein Token-Abo, keine Datenabhängigkeit von externen Anbietern.

Was kommt in den nächsten Beiträgen?

Diese Serie wird vermutlich aus folgenden Teilen bestehen (Reihenfolge kann sich ändern, je nachdem wie sich die Themen entwickeln und ich Zeit finde):

- Teil 1 (dieser Beitrag): Auftakt und Vorstellung der Vision

- Teil 2: ESP-IDF v5.5.4 einrichten und ESP-Claw bauen – Schritt für Schritt

- Teil 3: Ein neues Board zu ESP-Claw hinzufügen – meine Board-Adaption für das Guition JC1060P470

- Teil 4: ESP-Claw mit dem eigenen Ollama-Server verbinden – Konfiguration und erste Chats

- Teil 5: Capabilities und Skills verstehen – die Architektur eines ESP-Claw-Agenten

- Teil 6: Eine eigene Skill schreiben – das Roboter-Auto fernsteuern oder den Geschirrspühler erklären

- Teil 7: Sprache rein, Sprache raus – das HMI-Board als echter Voice-Assistant zur Unterstützung an der Waschmaschine

- Teil 8: Lua-Skripte für Verhaltensmuster – wenn der Agent eigenständig handelt

Was tatsächlich entsteht und in welcher Reihenfolge, hängt davon ab, worauf ich in der Praxis stoße und wie viel Zeit ich jetzt im Sommer dafür habe. Aber genau das macht für mich den Reiz aus: Echte Maker-Arbeit, mit echten Stolpersteinen und echten Aha-Momenten. Wie viele meiner Projekte entsteht dieses auch nebenbei und ich bin gespannt was daraus entstehen kann.

Die Brücke zu meinem Roboter-Auto Aktivitäten

Wer mich aus meiner Roboter-Welt kennt, weiß: Auf custom-build-robots.com zeige ich seit Jahren, wie ich ESP*- oder Raspberry Pi-basierte Roboter-Autos baue. Ausgestattet mit Motoren, Sensoren, Kameras und allem, was dazugehört. Auch mein Buch „Roboter-Autos mit dem ESP32″ (erschienen im Rheinwerk Verlag) deckt diese physische Seite ab.

Diese Serie hier auf meinem Blog ergänzt das um die KI-Schicht. Ein Roboter-Auto, das ich gebaut habe, bekommt einen sprechenden, denkenden Co-Piloten, der vom HMI-Board aus mit ihm kommuniziert. Wer also den kompletten Weg gehen möchte vom Lötkolben bis zum Sprachbefehl findet auf beiden Blogs zusammen die volle Geschichte.

Mein persönliches Fazit zum Auftakt

Wir leben in einer Zeit, in der KI-Agenten meistens als Cloud-Dienst angeboten werden. Jeder Sprachbefehl, jede Frage, jedes Foto wandert über das Internet zu einem fremden Server, wird dort verarbeitet und kommt verändert zurück. Das funktioniert aber es ist das Gegenteil von Souveränität. In den Eltern-Chat-Gruppen und bei Talenttagen an der Schule ist das aufnehmen von Bildern ein großes Thema. Da frage ich mich immer wie konsequent sind die lautesten Eltern dann im privaten und firmen Alltag bei der Nutzung von doch so bequemen Services?

Mit ESP-Claw auf einem HMI-Board wird der KI-Agent zur lokalen, eigenständigen Einheit. Er gehört mir. Er läuft bei mir. Er kommuniziert mit meinem Server. Niemand muss meine Daten lesen, niemand kann ihn abschalten, und ich zahle keine Gebühren pro Token.

Das ist die Vision dieser Serie. In den kommenden Beiträgen zeige ich euch, wie ich diese Vision Schritt für Schritt in die Realität umsetze mit allen Stolpersteinen, die so ein Pionier-Projekt mit sich bringt.

Wir lesen uns im nächsten Teil!

Ein toller Guide der leicht zugänglich und verständlich ist. Perfekt für ein kleines Side-Project geeignet. Aktuell half mir noch mein…

Thank you for this great tutorial, could you share n8n workflow and comfyui workflow please?

Hallo Anton, die Meldung besagt das in meinem Beisiel Methoden verwendet werden die veraltet (deprecated) sind. Also müsstest Du die…

Danke für das Tool! Ich habe erst kürzlich angefangen mich mit der Thematik zu beschäftigen und bin für meine Erwartungen…

Hallo, ich habe ihre Anleitung befolgt und bekomme im letzten Schritt leider immer folgende Meldung im Terminal: bash <(wget -qO-…